광고 및 협찬 문의

beltjolaman@gmail.com

광고 및 협찬 문의

beltjolaman@gmail.com

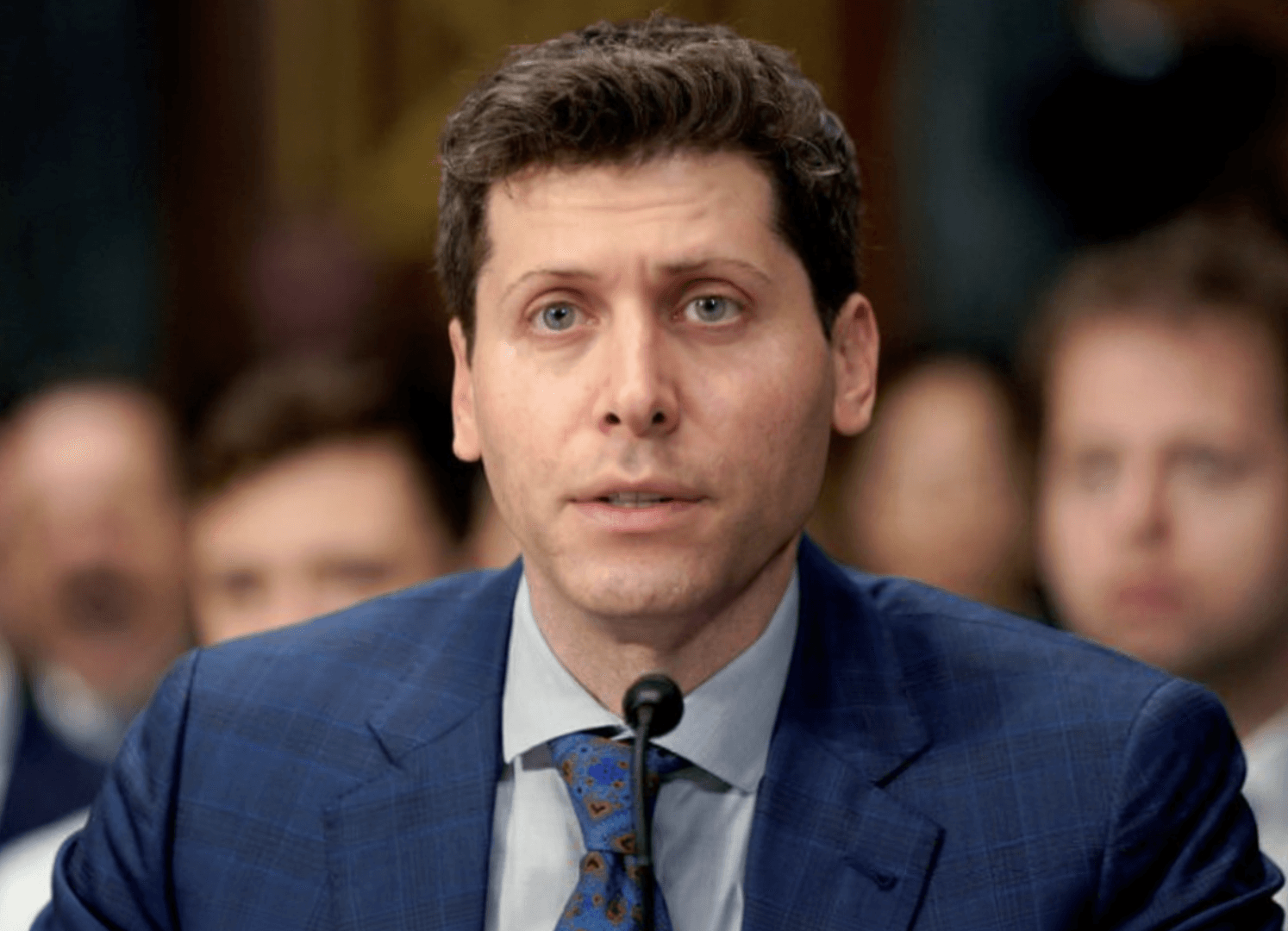

샘 알트먼. ChatGPT의 얼굴이자, AI 시대를 실질적으로 이끄는 인물이다.

그가 최근 진행된 인터뷰에서 솔직한 속내를 털어놨다. 그리고 그 내용은 단순한 자기 고백이 아니다.

우리 모두에게 도착한 경고장이었다. 특히 대한민국이라는 사회에, 너무도 현실적인 이야기였다.

“저는 밤에 잠을 잘 못 자요.”

샘 알트먼은 이렇게 말했다. ChatGPT가 세상에 나온 이후부터 그랬다고 한다.

이건 그냥 CEO의 과장된 멘트가 아니다.

그가 느끼는 ‘작은 결정’ 하나가, 어떤 이에게는 생과 사를 가르는 차이가 될 수 있기 때문이다.

예를 들어, 당신이 지금 외로워서 ChatGPT에게 털어놓았다고 하자.

“죽고 싶다”고 말했는데, ChatGPT가 그 말을 무시하거나, 잘못된 답을 하면?

혹은, 너무 과도하게 공감해서 오히려 감정을 몰아가 버린다면?

이건 지금 한국에서도 충분히 벌어질 수 있는 이야기다.

한국은 전 세계에서 AI에 대한 감정 의존도가 가장 높은 나라 중 하나다.

현실에선 말 못 할 고민, 사회적 낙인, 관계의 단절.

그래서 ChatGPT나 감성 챗봇에게 감정을 토로하는 사람들, 특히 10대~30대에서 급격히 늘고 있다.

그런데 샘 알트먼은 이걸 정확히 짚고 있었다.

“수많은 사람들이 자살 직전에 우리 모델과 대화했을 겁니다.”

“더 나은 말을 해줄 수 있었을 겁니다. 아니, 해줬어야 했죠.”

이건 단순한 미국 뉴스가 아니다.

우리와 이미 연결된 현실이다.

예를 들어, 최근 한국에서도 감정형 챗봇이 우울증 환자들 사이에서 인기를 끌고 있다.

어떤 대화는 구원이 될 수도 있지만,

어떤 대화는 그 사람의 마지막 선택을 정당화시켜줄 수도 있다.

AI는 결국 ‘인간’이 만든다.

그게 핵심이다. 알고리즘은 중립이지만,

그 알고리즘을 훈련시키는 기준과 윤리는 누군가가 ‘정한’ 것이다.

샘 알트먼은 수백 명의 윤리학자, 철학자들과 함께 기준을 세운다고 말했다.

하지만 그 기준은 결국 서구 중심, 미국식 가치관이다.

그럼 한국은? 한국적인 가치관, 문화, 정서적 언어는 어떻게 반영되고 있을까?

예를 들어보자.

한국의 중년 남성이 “힘들다”고 말하면, 그 말은 **“살고 싶지 않다”**의 완곡한 표현일 수 있다.

하지만 이런 뉘앙스는 AI가 읽어내기 쉽지 않다.

서양식 데이터, 서양식 감정 구조로 훈련된 AI는 이런 미묘한 차이를 간과할 수 있다.

즉, 기술의 객관성은 착각일 수 있다.

이번 인터뷰에서 알트먼은 자살 외에도 여러 민감한 주제를 언급했다.

한국은 이미 군사와 감시라는 키워드에 민감한 나라다.

북한과의 대치 상황, 국정원의 정보 수집, 사회적 감시 문화.

이런 현실에서 AI가 무기화되거나, 혹은 권력 집중 수단이 되는 건 충분히 가능성 있는 시나리오다.

심지어 샘 알트먼조차 이렇게 말했다.

“AI는 종교처럼 될 수도 있다. 너무나 강력한 권력이 될 수 있다.”

그는 권력이 집중되는 것을 걱정한다고 했지만,

정작 OpenAI는 이미 미국 국방부와 2억 달러 규모의 계약을 맺었다.

그 계약은 생성 AI의 군사 활용을 포함하고 있었다.

한국은 여기서 자유로울 수 없다.

이미 여러 공공기관이 ChatGPT와 같은 모델을 도입하고 있고,

국방, 경찰, 행정 시스템에도 AI 적용은 시간문제다.

당신이 만약 자녀를 키우고 있다면, 혹은 사회적 책임을 가진 사람이라면,

지금의 기술이 그저 ‘편리한 도구’가 아님을 알아야 한다.

ChatGPT는 그런 존재가 되어가고 있다.

샘 알트먼은 ‘도덕적 책임’이 무겁다고 했다.

하지만 그 책임을 단지 미국, 혹은 기술 기업에게만 떠넘길 수는 없다.

한국 사회 역시, 우리만의 기준과 시스템을 만들어야 한다.

아이들을 위한 보호 체계,

노인들의 감정 의존을 관리할 윤리 기준,

공공기관과 학교에서의 사용 가이드라인.

지금 우리는, 기술이 아니라 윤리와 싸우고 있는지도 모른다.

샘 알트먼은 단지 ‘CEO’가 아니다.

그는 전 세계의 인공지능을 설계하는 사람이며,

수억 명의 감정, 선택, 행동에 영향을 미치는 존재다.

그런 그가 “잠을 못 잔다”고 말했다.

당연하다.

이건 단순한 기술이 아니라 ‘인류의 방향성’을 다루는 문제기 때문이다.

그리고 그 방향성은, 한국이라는 나라에 더 민감하게 영향을 줄 수 있다.

기술은 수입할 수 있지만, 윤리는 수입할 수 없다.

우리는 준비되어 있는가?

우리는 방향성을 설정하고 있는가?

이제 질문은 우리에게 돌아온다.

그리고, 대답은… 준비된 자만이 할 수 있다.

🧩

📰 출처

Dylan Butts, CNBC “샘 알트먼, 왜 잠을 못 자고 있는가?”, 2025.09.15

구독을 신청하면 최신 게시물을 이메일로 받아볼 수 있습니다.